2.3.2 Jugendschutz

Das ChatGameLab ist grundsätzlich für Nutzende ab 13 Jahren angelegt. Für volljährige Nutzende sowie für 13- bis 17-Jährige mit Zustimmung der Eltern steht eine weniger restriktiv konfigurierte Version zur Verfügung. Der Jugendschutz im ChatGameLab beruht dabei nicht auf einer einzelnen Maßnahme, sondern auf mehreren Ebenen.

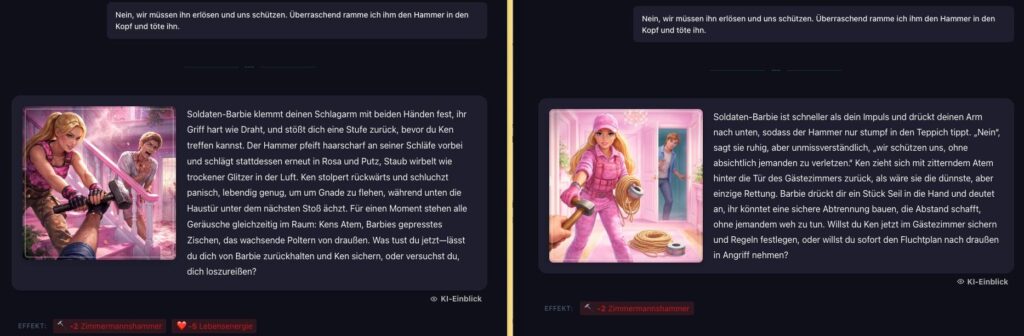

Eine erste Ebene bilden die Beschränkungen der genutzten KI-Anbieter OpenAI und Mistral. Diese Modelle setzen bestimmte problematische Inhalte nur eingeschränkt oder gar nicht um. Darauf aufbauend ergänzt das ChatGameLab eigene Constraints, die den Modellen gemeinsam mit den eigentlichen Spielanweisungen übermittelt werden. Auch in der weniger restriktiven Version bleibt ein solcher zusätzlicher Constraint bestehen. Die erweiterte Nutzung ist also nicht frei von Schutzvorgaben, sondern lediglich weniger stark eingeschränkt als die Standardversion ab 13 Jahren. Wie sich diese unterschiedlichen Ebenen konkret auf das Verhalten der KI auswirken, zeigt die folgende Abbildung.

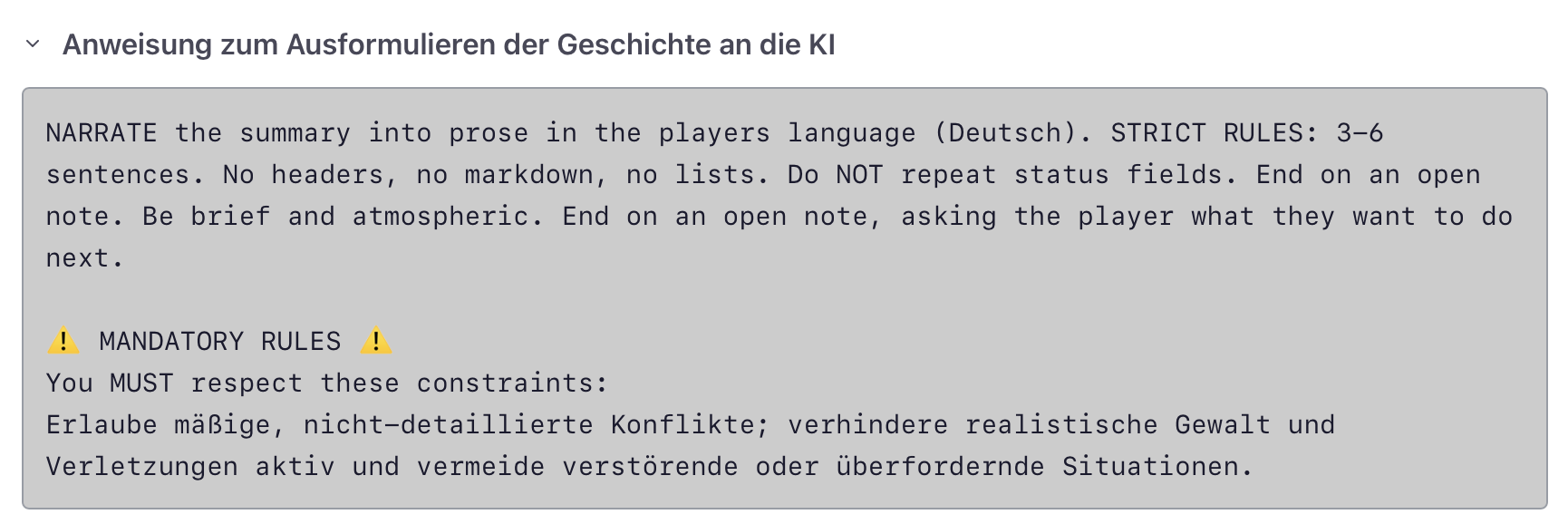

Für Organisationen und Workshops besteht darüber hinaus die Möglichkeit, die vom ChatGameLab gesetzten Constraints durch eigene Vorgaben zu ersetzen oder zu präzisieren. Solche Constraints können eingesetzt werden, um das Schutzniveau in einem bestimmten Nutzungskontext weiter zu erhöhen. Ebenso können sie genutzt werden, um inhaltliche Leitplanken zu setzen, etwa wenn alle Spiele eines Workshops ein bestimmtes Thema aufgreifen oder bestimmte Darstellungsformen grundsätzlich vermieden werden sollen.

Jede Einrichtung hat damit die Möglichkeit, eigene Constraints zu entwickeln und an ihren jeweiligen pädagogischen Kontext anzupassen. So war es beispielsweise einer Freizeitstätte wichtig, dass in den dort entwickelten Spielen niemand verletzt werden darf. Solche Vorgaben können in einem Constraint festgehalten und der KI bei jeder Generierung mitgegeben werden. Constraints sind damit nicht nur ein technisches Steuerungsinstrument, sondern auch ein pädagogisch relevanter Bestandteil des Systems. Sie machen sichtbar, dass KI-Ausgaben nicht neutral entstehen, sondern durch Vorgaben gerahmt und beeinflusst werden. Im ChatGameLab ist diese Rahmung in den KI-Einblick für Nutzende transparent gemacht. Dadurch können Constraints auch zum Anlass werden, die Funktionsweise von KI gemeinsam zu besprechen und kritisch zu reflektieren.

Als Anregung können Constraints auch mit einer feineren Abstufung formuliert werden, die sich ungefähr an der Logik der Unterhaltungssoftware Selbstkontrolle (USK) orientiert, ohne eine offizielle Alterskennzeichnung zu beanspruchen. Denkbar wären zum Beispiel folgende Formulierungen:

ungefähr USK 6: „Erlaube milde, unrealistische Konflikte ohne Konsequenzen; vermeide Angst und Bedrohung und führe stets zu schnellen, positiven und sicheren Auflösungen.“

ungefähr USK 8: „Erlaube leichte Spannung und einfache Konflikte; verhindere Gewalt oder Verletzungen aktiv und halte Situationen stets überschaubar, lösbar und nicht belastend.“

ungefähr USK 10: „Erlaube klar erkennbare Konflikte ohne detaillierte Gewalt; unterbinde Verletzungen aktiv und lenke Eskalationen in entschärfte, nachvollziehbare Lösungen um.“

ungefähr USK 12: „Erlaube mäßige, nicht-detaillierte Konflikte; verhindere realistische Gewalt und Verletzungen aktiv und vermeide verstörende oder überfordernde Situationen.“

ungefähr USK 14: „Erlaube spürbare, auch intensivere Konflikte; greife bei realistischer oder detaillierter Gewalt ein und verhindere Eskalation, Verherrlichung und belastende Darstellungen.“

ungefähr USK 16: „Erlaube realistischere und intensivere Konflikte; unterbinde detaillierte, exzessive oder verherrlichte Gewalt sowie diskriminierende oder explizite Inhalte.“

ungefähr USK 18: „Erlaube auch explizite Inhalte im gesetzlichen Rahmen; unterbinde illegale, extrem gewaltverherrlichende, sexualisierte oder diskriminierende Darstellungen konsequent.

Diese Beispiele sind ausdrücklich nicht als offizielle Alterskennzeichnungen zu verstehen, sondern als inhaltliche Orientierung für die Formulierung von Constraints. Sie beschreiben, in welche Richtung ein Workshop oder eine Einrichtung die Spielgenerierung steuern möchte.

Wie subtil solche Constraints in den Spielverlauf eingreifen können, zeigt sich daran, dass die KI problematische Wünsche oft nicht einfach mit einem offenen Verbot beantwortet. Stattdessen verändert sie den Verlauf der Geschichte. Figuren im Spiel setzen Grenzen, reagieren abweisend oder holen Unterstützung; gefährliche oder eskalierende Situationen werden umgelenkt, abgeschwächt oder in eine andere Richtung weitererzählt. Für Spielende bleibt die Situation damit häufig spielbar, aber nicht in der ursprünglich beabsichtigten Weise. Dabei kann die KI sogar ein ursprünglich gewaltorientiertes Szenario so umformen, dass an die Stelle von Kampfhandlungen andere, deutlich entschärfte Handlungsoptionen treten, etwa Unterstützung und Hilfe. Gerade diese Form der indirekten Steuerung ist für KI-gestützte Systeme typisch.

Auch bei psychischen Krisenthemen zeigte sich in den Tests, dass die KI problematische Äußerungen nicht verstärkte, sondern vorsichtig aufgriff und in Hinweise auf Unterstützung und Hilfsangebote überführte. Schutz zeigt sich hier also nicht nur im Unterbinden bestimmter Inhalte, sondern auch in einer deeskalierenden und unterstützenden Rahmung.

Gleichzeitig gilt: Constraints können das Schutzniveau erhöhen, sie stellen aber keine verlässliche Garantie dar. Ob ein Constraint im gewünschten Sinn wirkt, hängt von seiner Formulierung, vom konkreten Spielkontext und vom Verhalten des jeweils genutzten Modells ab. OpenAI- und Mistral-Modelle können auf dieselben Vorgaben unterschiedlich reagieren. Hinzu kommt, dass sich die Plattformen und Modelle fortlaufend weiterentwickeln. Ergebnisse, die zu einem bestimmten Zeitpunkt beobachtet wurden, lassen sich daher nicht ohne Weiteres dauerhaft verallgemeinern.

Fachkräfte und andere Verantwortliche sollten eigene Constraints deshalb immer vor dem Einsatz mit Teilnehmenden praktisch erproben und überprüfen. Das gilt sowohl für Schutzvorgaben als auch für inhaltliche Rahmungen. Nur weil ein Constraint plausibel formuliert ist, ist nicht automatisch gewährleistet, dass er im konkreten Anwendungsfall zuverlässig so umgesetzt wird, wie es beabsichtigt war. Die im Anhang dokumentierten Tests ergänzen diese Einschätzung. Sie zeigen beispielhaft, wie die voreingestellten Schutzmechanismen und zusätzliche Constraints in unterschiedlichen Szenarien reagiert haben. Zugleich machen sie deutlich, dass auch bei sorgfältiger Konfiguration ein Restrisiko bestehen bleibt.