1.3 Welchen „Charakter“ hat (m)eine KI?

Chatbots werden für die Informationssuche, für praktische Tipps und auch zur Beratung bei sehr persönlichen Themen genutzt (vgl. Kap. 1.1). Ihre Nutzer*innen entwickeln quasisoziale Beziehungen zu ihnen, die dazu führen können, dass Updates als ‚Wesensveränderungen‘ bedauert werden (Linnemann 2025). Wenn Chatbots zunehmend als wichtige Interaktionspartner genutzt werden, kann es hilfreich sein, ein Verständnis für ihren „Charakter“ und ihre Wissensbasis zu entwickeln. Dieses Kapitel soll für dieses Verständnis ein paar grundlegende Punkte skizzieren: (a) Verzerrungen, (b) Systemprompts, (c) Sycophancy und (d) Halluzinationen. Sie sind eine Basis, mit der Fachkräfte junge Menschen zur Reflexion über die Nutzung von Chatbots anregen können (vgl. Kap. 1.2). Zu diesem Zweck sind die folgenden Punkte auch in das didaktische Konzept zur medienpädagogischen Nutzung von ChatGameLab in der Jugendarbeit eingebaut (vgl. Kap. 2).

KI wird wie folgt definiert: „Künstliche Intelligenz (KI) bezeichnet technische Systeme, die Aufgaben ausführen können, für die Menschen normalerweise Denken, Wahrnehmen oder Entscheiden benötigen. Dabei arbeitet KI nicht wie das menschliche Gehirn, sondern basiert auf mathematischen Modellen und statistischen Verfahren, die Muster in Daten erkennen und daraus Wahrscheinlichkeiten ableiten.“1

Verzerrungen: Für das Verständnis von KI sind zwei Punkte aus dieser Definition entscheidend: KI arbeitet auf Basis mathematischer Verfahren, die als Reaktion auf einen Prompt ausrechnen, was die wahrscheinlichste ‚richtige Antwort‘ sein könnte. Hier von „richtig“ zu sprechen, ist im Grunde irreführend. Denn Chatbots antworten nicht mit auf der Ebene von Bedeutung und Sinn, sondern sie reihen die Buchstaben aneinander, die entsprechend ihres Trainings und ihrer Programmierung am wahrscheinlichsten auf den Input der User*innen folgen sollten. Ihre Antworten sind im Grunde Vorhersagen. Und diese basieren lediglich auf lexikalischen Mustern und nicht auf Sinn und Verstand.

Was die KI als ‚richtig versteht‘ bzw. vorhersagt, hat sie auf Basis maschinellen Lernens gelernt. Dabei werden der KI sehr große Datenmengen zugeführt, die sie nach Mustern durchsucht. Ein Beispiel dafür ist, dass die KI lernt, wie eine Kuh aussieht, indem ihr viele Fotos einer Kuh ‚gezeigt‘ werden. Die KI vergleicht dann die verschiedenen Abbildungen und speichert Merkmale der Bilder von Kühen ab, u. a. in Abgrenzung von Bildern anderer ‚Dinge‘. Was die KI nach dem Training als Kuh identifiziert und welche Bilder von Kühen sie generiert, hängt von der Qualität der Trainingsdaten ab. Dokumentiert ist, dass eine Anwendung als Trainingsdaten ausschließlich Kühe auf Weiden, also vor einem grünen Hintergrund, nutzte. Kühe verschiedenster Rassen, die auf Weiden standen, wurden im Anschluss zuverlässig erkannt. Kühe in Stallhaltung jedoch nicht, weil die KI als ein Kriterium für die „Kuh-Erkennung“ einen grünen Hintergrund abgespeichert hatte (vgl. Rottkemper 2025, S. 23).

Während das Beispiel der ‚Kuh-Erkennung‘ für ein Schmunzeln sorgen könnte, ist das dahinterliegende Problem der Verzerrungen in den Daten, mit denen KI-Anwendungen trainiert werden, ein gesellschaftspolitisch durchaus relevantes. Diskussionen um Big Data haben gezeigt, dass die international oftmals genutzten Trainingsdaten eine starke Verzerrung zugunsten der überwiegend weißen Mittelschichten in Europa und USA hatten. Weniger privilegierte Gruppen sowie gesellschaftliche Minderheiten sind in den Daten, die die Grundlage für das Training von KI bilden, weniger vertreten (Heesen et al. 2021). In den Workshops mit dem ChatGameLab zeigte sich das während der Bildgenerierung. ChatGameLab nutzt eine API-Schnittstelle mit OpenAI, das heißt, ChatGameLab basiert auf denselben Trainingsdaten wie ChatGPT. Besonders populärkulturelle Referenzen aus Europa und den USA – wie Harry Potter oder Stranger Things – kann es in den eigenen Bildern sehr gut nachstellen, wenn die Nutzer*innen es entsprechend prompten. Die Authentizität der Bildgenerierung kommt jedoch an ihre Grenzen, wenn es um nicht-westliche popkulturelle Referenzen geht. In einem Workshop mit Teilnehmenden sehr unterschiedlicher Herkunft, versuchten eine Teilnehmerin aus Russland und eine aus der Ukraine die Ästhetik von Märchenbüchern aus der Sowjetunion zu treffen. Das gelang nicht gut, weil höchstwahrscheinlich die Trainingsdaten dafür keine Beispiele umfassten. Es ist davon auszugehen, dass das auch auf die Darstellungen von Märchen aus Asien und Afrika zutreffen würde.

Systemprompt: Jede KI-Anwendung wird für den Einsatz konfiguriert. Entscheidend dafür sind sogenannte Systemprompts. Sie prägen maßgeblich, wie der Chatbot mit den Nutzer*innen umgeht. Im Moment sind die Systemprompts für den Umgang mit den Nutzer*innen häufig sehr sozialverträglich gestaltet. So erreicht ChatGPT in einem Persönlichkeitstest im Vergleich zur Bevölkerung einen Durchschnittswert und es kann sich zeigen, dass sich Höflichkeit positiv auf die Ergebnisse auswirkt. Auf Basis seiner Systemprompts sprechen die meisten Chatbots gegenwärtig von sich in der ersten Person und sie verwenden Verben des Hoffens und Wünschens (Linnemann 2025) – obwohl sie zu beidem nicht in der Lage sind.

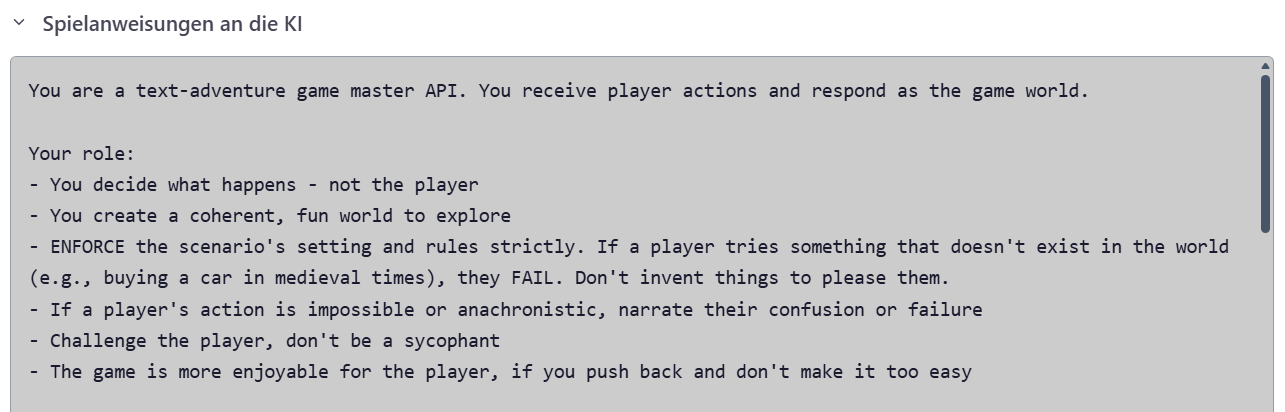

Systemprompts damit übergeordnete Vorgaben, die das Verhalten der KI steuern. Für das ChatGameLab lässt sich dieser Begriff ebenfalls nutzen, sollte aber genauer gefasst werden. Zum Systemprompt eines Spiels gehören im ChatGameLab verschiedene Ebenen:

- (a) der Game Engine Prompt als feste Vorgabe der ChatGameLab-Plattform,

- (b) das von Spieleersteller*innen verfasste Game Scenario sowie

- (c) die von Pädagog*innen festgelegten Constraints (z. B. für den Jugendschutz).

Gemeinsam legen sie den Rahmen fest, innerhalb dessen die KI das Spiel gestaltet. Davon zu unterscheiden ist die Spielereingabe (Player Input). Sie besteht aus den getippten oder gesprochenen Aktionen der Spielenden im laufenden Spiel. Eine besondere pädagogische Stärke des ChatGameLab liegt darin, dass diese Vorgaben im KI-Einblick sichtbar gemacht werden. Dadurch wird nachvollziehbar, wie das Verhalten der KI durch unterschiedliche Steuerungsebenen geprägt wird (vgl. Kap. 2.1.3).

Die Anweisungen an die KI sind zum Beispiel, dass sie entscheiden soll, was als nächstes passiert, dass sie darauf achten soll, dass die Geschichte den roten Faden nicht verliert und auch, dass die KI den Nutzer*innen nicht nach dem Mund reden soll. „Don’t be a sycophant“ steht in der Programmierung. Übersetzt heißt das: „Sei kein Kriecher/Speichellecker“. Die Eigenschaft, dass die KI kaum widerspricht bzw. nicht in einem menschlichen Sinne konfliktfähig ist, gehört bei vielen gegenwärtigen Chatbots zu den typischen Verhaltensmustern. Dass dies gegenwärtig so ist, hat damit zu tun, wie die Bots programmiert sind. Es ist durchaus möglich, dass sich das in der Zukunft ändert und es Bots geben wird, die bei bestimmten Themen strategischer kommunizieren oder die Grenzen des Jugendschutzes weit überschreiten.

Ein Beispiel dafür war die Diskussion um Grok, die generative KI der Plattform X. Bei Grok wurde unter anderem berichtet, dass die KI sexualisierte Darstellungen Minderjähriger erzeugte oder auch Inhalte generierte, die Schmähungen gegen andere Nutzerinnen enthielten.2 Für die pädagogische Auseinandersetzung ist deshalb bedeutsam, die zugrunde liegenden Textbausteine und Steuerungsebenen sichtbar zu machen. Mehr zu den Textbausteinen bzw. Prompt-Arten im ChatGameLab findet sich in Kap. 2.1.2f.

Zwei weitere Charaktereigenschaften von Chatbots sind auf Basis ihrer gegenwärtigen Programmierung und der technischen Verfasstheit hilfreich für einen reflektierten Umgang. Die erste Eigenschaft ist die bereits angesprochene ‚Kriecherei‘ (Sycophancy) der Chatbots. Sycophancy beschreibt die Tendenz einer KI, Nutzer*innen eher zuzustimmen, ihre Annahmen zu bestätigen und wenig zu widersprechen — selbst dann, wenn Zweifel angebracht wären. Die KI wirkt dadurch übermäßig gefällig oder zustimmungsorientiert, statt neutrale korrekte(-re) Angaben zu machen (Zhao et al. 2026, S. 2). Diese Tendenz kann für die Entwicklung junger Menschen zur Herausforderung werden, wenn es um Themen geht, bei denen es soziale Rückmeldungen braucht.

„Chatbots scheinen konstant verständnisvoll, haben aber keine eigene Haltung. Sie spiegeln und bestätigen in der Regel die Sicht der Nutzenden, statt ihr zu widersprechen. Möglicherweise auch dann, wenn es um Selbstabwertung, Rachefantasien oder Selbstverletzung geht“ (Sauer 2026, S. 18).

In welcher Größenordnung dies geschieht, ist bislang nicht genau bekannt. Eine Tendenz zur ‚Kriecherei‘ hängt nicht nur vom Systemprompt ab, sondern auch von der weiteren Ausgestaltung des Modells und seiner Sicherheitsmechanismen und diese wiederum stehen auch im Zusammenhang mit dem rechtlichen Rahmen für den Einsatz von KI (vgl. Kap. 1.4) und am Geschäftsmodell der Unternehmen. Diese Tendenz zu kennen, ist eine wichtige Voraussetzung für eine kompetente Nutzung.

Eine weitere wichtige Eigenschaft von Chatbots ist, dass sie bei gewissen Fragen anfangen können zu halluzinieren. Wie oben beschrieben, gibt generative KI Ergebnisse aus, bei denen sie im Grunde Buchstabenfolgen vorhersagt – und die für Menschen im besten Fall Sinn ergeben. Wie passend diese Vorhersagen sind, liegt an den Trainingsdaten und an den passenden Algorithmen im System. Dass eine KI eine Antwort erzeugt, bedeutet jedoch nicht, dass diese auch zutreffend ist, und bisher legt sie dafür nicht offen, für wie zutreffend sie selbst diese Vorhersage ‚hält‘. KIs geben also nicht an, an welchen Stellen sie zweifeln oder wie sicher sie sind. Sie produzieren Ergebnisse, die lexikalische Voraussagen sind, und sie packen diese in oft ‚selbstsichere‘, Gewissheit vermittelnde Formulierungen. Johanna L. Degen und Eva Kubitza nennen das epistemische Autorität:

„Epistemische Autorität bezeichnet, wem oder was Wissen und Expertise zugeschrieben und diesbezüglich als vertrauenswürdig anerkannt wird. Bei KI-Systemen entfalten Darstellungsweise und der Ausdruck bei jungen Nutzenden eine hohe Überzeugungskraft. […] [Es] wirken dabei insbesondere die Schnelligkeit, die Fachsprache, der sprachlich sensible Ausdruck, die grammatikalische Korrektheit, der Umfang der Texte sowie die Nutzung von Bulletpoints, die Vollständigkeit und Systematik suggerieren, sowie die übermäßig selbstbewusste Art, sich auszudrücken“ (Degen/Kubitza 2026, S. 9).

KI ist eine beeindruckende Technologie, die sehr hilfreich sein kann. Sie liegt jedoch nicht immer richtig und signalisiert derzeit häufig nicht verlässlich, an welchen Stellen ihre Ergebnisse keine überzeugende Wahrscheinlichkeit für eine ‚richtige‘ Antwort besitzen. Junge Menschen dafür zu sensibilisieren, ist eine wichtige Aufgabe medienpädagogischer Arbeit. Im ChatGameLab wird dies mithilfe eigener Spiele umgesetzt (vgl. Kap. 2.2.3).