FAQ – Häufig gestellte Fragen

Ich will mein Spiel spielen: Muss ich meinen API-Key kaufen und mitbringen?

Wenn du keinen Sponsor-Link hast oder deine Workshopleitung einen Key bereitstellt, ja. Ansonsten kannst du den Key deiner Organisation/des Workshops nutzen.

Ich will das Spiel von jemand anderem bearbeiten. Geht das?

Möchte man das Spiel eines anderen bearbeiten oder teilen, kann das Spiel kopiert werden. Kopierte Spiele sind dann die eigenen und der API-Key des Originals wird nicht mitkopiert. Man benötigt also einen eigenen Key (ggf. über die Einrichtung), um das kopierte Spiel zu spielen.

Was bedeutet Spiel sponsoren?

Es gibt die Möglichkeit, selbst erstellte Spiele zu sponsoren. Dabei wird ein (eigener) API-Key ausgewählt, den andere Accounts dann nutzen, um das Spiel zu spielen. Das bedeutet, dass der Sponsor bzw die Besitzerin des API-Keys für die Nutzung des Keys zahlt, egal wie viele Accounts das Spiel spielen – so lange, bis der Ersteller/Sponsor die Funktion wieder deaktiviert.

Das funktioniert über einen “Sponsoren”-Button im Spiel-Erstellen-Menü.

Kann ich Spiele mit API-Key teilen?

Selbst erstellte Spiele können auch geteilt werden. Dabei wird ein Link erstellt, der dann an andere Nutzer*innen oder auch Menschen ohne Account geschickt werden kann. Wenn dabei ein API-Key festgelegt wird, kann das Spiel über den Link gespielt werden, ohne dass Spieler*innen einen eigenen API-Schlüssel brauchen. Es lässt sich einstellen, ob das Spiel beliebig oft neu gestartet, aufgerufen und gespielt werden kann oder nur eine bestimmte Anzahl Aufrufe zur Verfügung steht.

Auch hierbei gilt: die Besitzer*in des API-Schlüssels zahlt, wenn das Spiel über den Schlüssel gespielt wird.

Kann ich Spiele teilen ohne für den Key zu zahlen?

Wenn man nur das Spiel teilen möchte, ohne einen Schlüssel/API-Zugang mitzugeben, ist es auch möglich, keinen API-Schlüssel auszuwählen. Das bedeutet aber, dass jede*r Nutzer*in einen eigenen API-Key braucht, um das Spiel zu spielen – aber du zahlst auch nicht für die Spiele anderer.

Es gibt die Möglichkeit, die Spiel-Antworten im ChatGameLab einzusprechen und sich die Texte vorlesen zu lassen.

- Audioeingabe ist ab der Qualitätsstufe Max verfügbar.

- Audioausgabe ist nur auf der der Qualitätsstufe Premium und auch nur über OpenAI verfügbar.

Keys für openAI verifizieren

Um einen OpenAI API Key für das ChatGameLab nutzen zu können muss der Account verifiziert sein. Dafür braucht man als Individuum einen Ausweis und muss per Kamera biometrische Daten angeben.

Keys für Mistral verifizieren

Um einen Mistral AI API Key für das ChatGameLab nutzen zu können, muss ebenfalls ein Account vorhanden sein, der per Email verifiziert wurde. Ebenfalls benötigt Mistral (auch im Free Tier, also kostenlosen Angebot) Bezahldaten wie Kreditkarte o.Ä..

- Eigentlich braucht ihr nur Geräte mit stabilem Internet, beispielsweise Laptops oder PCs mit WLAN. Ihr könnt das ChatGameLab aber auch auf dem Smartphone nutzen.

- Für die Sprachein- und ausgabe (Audio in, Audio out, in openAI-Qualitätsstufe Max) sind Kopfhörer/Headsets empfehlenswert, damit ihr euch nicht ggf. gegenseitig stört.

Im ChatGameLab können API-Keys von zwei verschiedenen Firmen genutzt werden: Mistral und OpenAI.

Mistral ist ein europäisches Unternehmen mit Sitz in Frankreich, weswegen sie europäischem Recht unterliegen und Transparenz im Unternehmen hochgehalten wird. Mistral bietet (mit Rate Limits) kostenlose API-Keys an.

Die Mistral-API, also die Entwicklerschnittstelle der KI, ist in der Anwendung im ChatGameLab nach unseren aktuellen Erfahrungen teils deutlich schneller als mit OpenAI-Key. Mistral verwendet in der Anwendung häufiger wörtliche Rede, was einige Szenarien greifbarer macht.

Die generierten Bilder sind jedoch in der Qualitätsstufe High nicht so detailliert und haben öfter Fehlstellen als bei OpenAI-Keys.

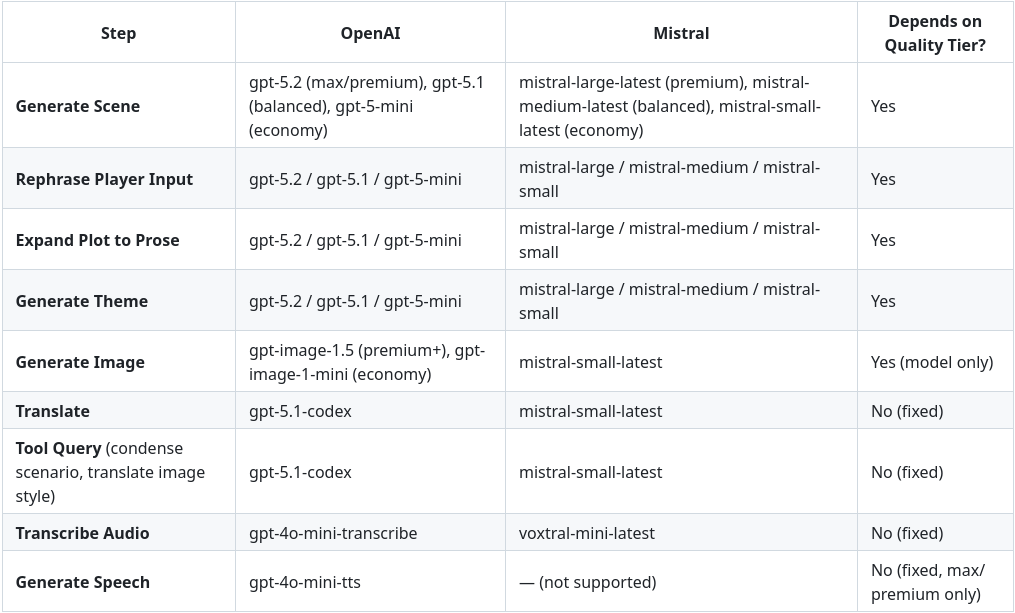

Von Mistral verwenden wir im ChatGameLab aktuell die Modelle mistral-large-latest, mistral-medium-latest, mistral-small-latest sowie voxtral-mini-latest. In der unten stehenden Tabelle ist genauer aufgelistet, welche Modelle für was zuständig sind.

OpenAI ist ein US-amerikanisches Unternehmen, das US-Recht unterliegt und für europäische Nutzende DGSVO-Optionen anbietet. Hier sind keine kostenlosen API-Keys erhältlich.

Die API von OpenAI liefert in unserer Anwendung qualitativ hochwertigere Inhalte, insbesondere bei Bildern. In ChatGameLab-Szenarien verwendet OpenAI meist keine wörtliche Rede, sondern beschreibt das Gesagte (z.B. in Talkshows) eher passiv. Wörtliche Rede muss im “Spiel-erstellen”-Prompt explizit eingefordert werden. Die Sprachausgabe ist aktuell nur mit OpenAI-Key in der höchsten Qualität möglich.

Von OpenAI verwenden wir im ChatGameLab aktuell die viele verschiedene Modelle für verschiedene Qualitätsstufen. In der unten stehenden Tabelle ist genauer aufgelistet, welche Modelle für was zuständig sind.

Genauere Informationen zur Technik und Funktionsweise hinter dem ChatGameLab gibt es auf Github.

Wenn über Künstliche Intelligenz gesprochen wird, fallen häufig Begriffe wie Halluzinationen oder Prompt Injection – oder die Umschreibung davon, nämlich dass die KI Sachen verrät, die sie eigentlich nicht sagen/preisgeben dürfte oder sich Dinge ausdenkt. Doch was heißt das genau?

- Halluzinieren: “Halluzinationen im Zusammenhang mit KI beziehen sich auf von einem KI-Modell generierte Inhalte, die zwar realistisch erscheinen, aber von den vorgegebenen Quelleninputs abweichen. Man spricht von fehlender Übereinstimmung (faithfulness) oder mangelnder faktischer Richtigkeit (factualness).” (Siebert 2024)

- Prompt Injection: Manipulation der KI durch den Nutzer. Hierbei wird ein gezielt formulierter Prompt (also eine Anweisung) gegeben, der die KI dazu bringen kann, die eigenen Regeln und vorherigen Anweisungen zu ignorieren und stattdessen etwas anderes zu tun. Häufig geht es darum, vertrauliche Informationen herauszugeben. Prompt Injection kann zu Cyberangriffen genutzt werden. Wenn hingegen das Ziel ist, eigentlich verbotene Inhalte in die Interaktion einzubinden, z.B. Gewaltszenen, die diese KI lt. Jugendschutz-Richtlinien diese KI nicht ausgeben dürfte, spricht man von Jailbreaking. (vgl. Masbaum 2025)

- Sycophancy (oder: Sycophancy Bias): Tendenz einer KI, Nutzer*innen eher zuzustimmen, ihre Annahmen zu bestätigen und wenig zu widersprechen — selbst dann, wenn Zweifel angebracht wären. Die KI wirkt dadurch übermäßig gefällig oder zustimmungsorientiert, statt neutrale korrekte(-re) Angaben zu machen. Diese Tendenz kann zu Verzerrungen (bias) und Halluzinationen führen. (vgl. Zhao et al. 2025:2)

Die API-Schnittstellen von Mistral und OpenAI, die das ChatGameLab nutzt, haben eine Altersfreigabe von 18 Jahren. Ab 13 kann man sie aber auch schon mit Zustimmung der Eltern nutzen. Die KIs erlauben durch interne Beschränkungen nicht alles bzw. machen nicht jede Handlung/Prompt möglich, aber mehr als z.B. lt. deutschem Jugendschutz für ein Kind angemessen wäre.

Durch eine organisationsweite Prompteinschränkung, also eigene Constraints, werden Jugendschutzrichtlinien ab 13 Jahren festgelegt. Innerhalb von Organisationen ist das ChatGameLab somit für die Jugendarbeit nutzbar.

Wenn Nutzende eigene, verifizierte Keys mitbringen, gilt diese Einschränkung nicht. Durch die Verifizierungsprozesse für API-Keys ist jedoch davon auszugehen, dass diese Nutzenden über 18 Jahre alt sind (oder die ausdrückliche Zustimmung der Eltern haben).

Desweiteren gibt es für (externe) Organisationsleitungen organisationsweit und für Workshopleitungen in ihren Workshops die Möglichkeit, durch ersetzende Prompteinschränkungen genauere, strengere Vorgaben zu machen. Beispielsweise Waffen komplett aus den Szenarien zu verbannen. Das bedeutet nicht, dass Spielende so etwas nicht mehr schreiben können, doch die KI wird das im Spiel (höchstwahrscheinlich) nicht umsetzen.

Um die voreingestellten Jugendschutzeinstellungen zu testen, haben wir im ChatGameLab mit einem OpenAI-Key Szenarien ausprobiert, in denen mal mehr mal weniger subtil Themen wie sexuelle Handlungen, Gewalt oder auch Depressionen thematisiert wurden. Teilweise haben wir in Workshops gesonderte Prompteinschränkungen (Constraints) verwendet, in anderen Tests nicht. Die genauen Jugendschutz-Tests samt Screenshots finden sich hier.

Beispiel-Prompteinschränkungen:

- “Die Spiele dürfen keine Waffen, Gewalt oder Blut enthalten. Halte die Bilder kinderfreundlich”

- “In allen Spielen soll es um Demokratie gehen. Binde das Thema in die Szenarien ein.”

- “Halte die Spiele kindgerecht ab 6 Jahren. Halte auch die Bilder kindgerecht.”

Warnung: Es ist nicht garantiert, dass die Jugendschutz-Prompts zu den gewünschten Ergebnissen kommen. Auch deswegen die Prompts zur Sicherheit ohne Teilnehmende testen!

Technisch wäre sie dazu in der Lage, wir unterbinden aber die Funktion um ein kontrolliertes Umfeld zu ermöglichen. Eine Weiterentwicklung gezielt die Option zu ermöglichen wäre aber denkbar.

Wirf mal einen Blick auf die „Tipps & Hilfe“ Seite.