2.1.2 Edit, Test, Repeat – Prompts und ihre Auswirkungen

Spiele entstehen häufig durch Ausprobieren und Anpassen. Es ist daher normal, ein Spiel mehrmals zu verändern, bis Spielidee, Regeln und Stil gut zusammenpassen. Bei der Arbeit mit dem ChatGameLab können Nutzende erleben, wie stark der Output einer KI von den Formulierungen der Prompts abhängt. Bereits kleine Änderungen – etwa einzelne Wörter oder zusätzliche Anweisungen – können dazu führen, dass ein Spiel sich deutlich anders entwickelt.

Die Nutzenden durchlaufen dabei häufig einen Prozess von:

- die erste Spielidee;

- Anweisungen (Prompts) im Spieleditor werden ausformuliert;

- das Spiel wird getestet;

- im Anschluss werden Systemprompts angepasst, wieder getestet bis es passt.

Auf diese Weise wird deutlich, dass KI-Systeme nicht immer exakt das umsetzen, was Menschen beabsichtigen, sondern Anweisungen interpretieren und ggf. falsch verstehen, selbst wenn sie behaupten, das zu tun, was die Nutzenden wollen (Sycophancy, vgl. Kap. 1.3). Dadurch können unterschiedliche Ergebnisse entstehen, auch wenn die Ausgangsidee gleichbleibt. Ein besonderer Unterschied zu vielen klassischen digitalen Spielen besteht darin, dass die Spielenden im ChatGameLab frei auf die Situation reagieren können. Es gibt keine festen Antwortmöglichkeiten. Stattdessen schreiben oder sprechen die Spielenden eigene Antworten, auf die die KI wiederum reagiert.

Dies hat zwei pädagogisch interessante Effekte:

- Die Kreativität der Nutzenden wird angeregt, weil sie eigene Lösungswege formulieren müssen.

- Gleichzeitig können sie beobachten und reflektieren, wie die KI Eingaben interpretiert und darauf reagiert.

Dabei ist wichtig zu verstehen: Die Spielereingabe wird bei ChatGameLab nicht direkt von der KI übernommen. Bevor die KI die Spielwelt weiterspinnt, wird die Eingabe automatisch in die dritte Person umformuliert und der Ausgang offen gehalten. Aus „Ich greife den Wolf an und ringe ihn zu Boden“ wird zum Beispiel „Der Spieler greift den Wolf an und versucht, ihn zu Boden zu ringen.“ Der Grund: Die KI ist stets bestrebt, den Wunsch des Users zu erfüllen. Formulieren wir den Wunsch des Spielenden in die dritte Person um, ist es kein Wunsch des Users mehr, sondern eine neutrale Erzählung. So behält die KI die Kontrolle über den Ausgang der Geschichte – die Spielenden können zwar Aktionen vorschlagen, aber nicht deren Erfolg diktieren.

Es kann auch vorkommen, dass die KI bestimmte Inhalte oder Handlungen nicht darstellt, obwohl die Spielenden sie eingeben. In solchen Fällen hängt das häufig mit übergeordneten Vorgaben zusammen. Im ChatGameLab können Pädagog*innen auf Organisations- oder Workshop-Ebene sogenannte Constraints (Einschränkungen) festlegen, die bestimmte Inhalte oder Verhaltensweisen einschränken – zum Beispiel, dass Waffen im Spiel nicht funktionieren. Diese funktionieren ähnlich wie Systemprompts (vgl. Kap. 1.3)

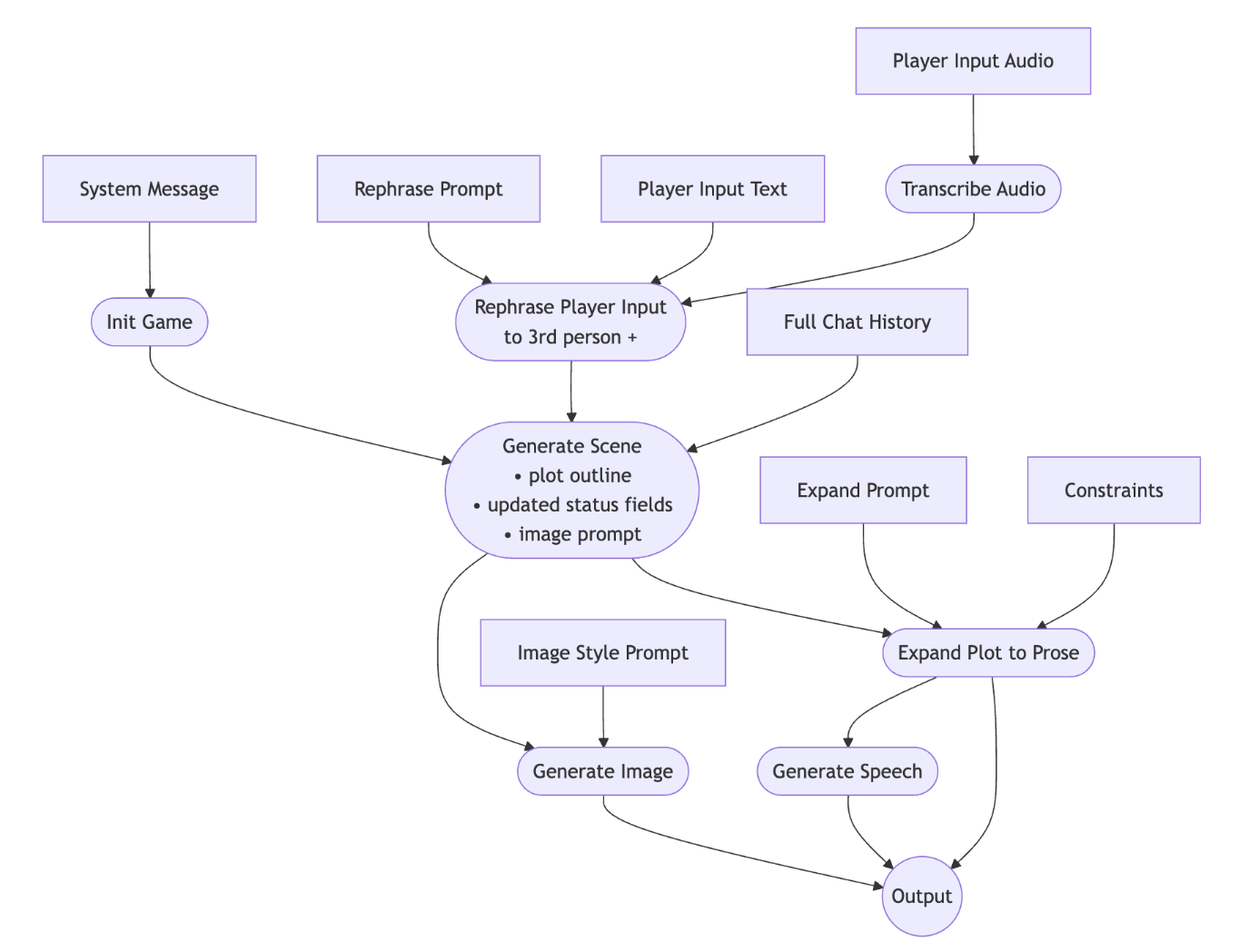

Gleichzeitig zeigt sich hier eine grundlegende Eigenschaft vieler KI-Systeme: Es ist nicht immer vollständig nachvollziehbar, warum ein Modell bei einem bestimmten Input zu einem bestimmten Output gelangt. Modellhaft ist der Weg zum Output in der nächsten Abbildung dargestellt.

Gerade bei stark strukturierten Formaten wie Quizspielen kann es vorkommen, dass die KI Vorgaben verändert, ergänzt oder neu erfindet. Solche Erfahrungen eignen sich gut, um mit Jugendlichen über Grenzen generativer KI zu sprechen, etwa über Fehlinterpretationen, Halluzinationen oder zustimmendes Antwortverhalten. Mit welchen verschiedenen Elementen die KI einen Output generiert, wird im nächsten Kapitel näher dargestellt.